Reconnaissance dimage : Google et Stanford publient leurs résultats

Reconnaissance dimage : Google et Stanford publient leurs résultatsLe Deep Learning aurait amélioré la précision du système

Lintelligence artificielle a connu une grande avancée durant les 40 dernières années, elle a des applications un peu partout aujourdhui. Le « Deep Learning » constitue une de ces techniques dapprentissage les plus à la mode aujourdhui.

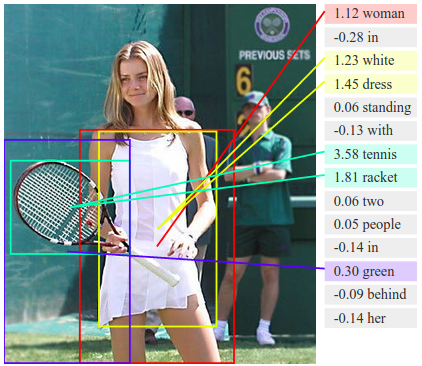

Une équipe de recherche à Google ainsi quune autre à Stanford lont utilisé récemment dans une problématique assez intéressante : la description de scènes. Le but est de créer des programmes qui prennent en entrée une image et génèrent en sortie un texte qui décrit cette image. Ceci pourra être très utile pour améliorer les résultats de recherche de Google Images par exemple, mais aussi dans la lutte contre le crime, pas seulement en identifiant les individus par une reconnaissance faciale, mais également en reconnaissant ce quils sont en train de faire, et envoyer un message à la police, et ceci, de manière automatique, grâce aux images des caméras de surveillance.

La problématique de reconnaissance de scènes nest pas nouvelle, plusieurs chercheurs travaillent sur le sujet pour créer des robots capables de reconnaître les activités des humains dans le but daider les personnes âgées et les malades. Un autre exemple encore quon peut citer est le cas des voitures autonomes ou semi-autonomes, qui peuvent identifier les piétons et les cyclistes traversant la route pour alerter le conducteur (sil y en a) ou freiner en cas durgence.

Mais la caractéristique principale de létude de Google et de Stanford, cest quelles combinent le domaine de la reconnaissance des images avec celui de la génération de texte, tout en utilisant le Deep Leaning. Un réseau de neurones convolutif profond est utilisé pour la classification dobjets dans la scène, la sortie est directement utilisée comme entrée pour un autre réseau de neurones modélisé de telle sorte à produire des phrases. « On peut ensuite entraîner lensemble du système directement avec des images annotées, de façon à maximiser les correspondances » disent les chercheurs. Résultat : le système peut décrire la scène en quelques fractions de seconde avec une précision qui dépasse celle des autres recherches publiées auparavant. Les scientifiques sont optimistes et disent vouloir entraîner le système avec plus dimages, ce qui devrait, selon eux, améliorer encore plus les résultats.

Pour les intéressés, léquipe de Standford va bientôt publier le code source ainsi que les données utilisées durant létude.

Source : Stanford, Google Research Blog

Et vous ?

Quen pensez-vous ?

Quen pensez-vous ?

Vous avez lu gratuitement 445 articles depuis plus d'un an.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.